«Η σημερινή επιστημονική φαντασία είναι η αυριανή επιστημονική αλήθεια» αφόριζε, ήδη από το 1950, ο Ισάακ Ασίμωφ, ακαδημαϊκός και συγγραφέας και δημοσιογράφος και γενικά σοφός. Ο καθηγητής του Boston University, πατέρας της επιστημονικής φαντασίας, έθεσε το ερώτημα κατά πόσο μια μηχανή μπορεί να διαθέτει ευφυΐα και κατ’ επέκτασιν κατά πόσο μια ευφυής μηχανή, που ονομάζουμε ρομπότ, μπορεί να έχει συνείδηση.

Γιατί εάν ένα ρομπότ μπορεί να αποκτήσει συνείδηση σημαίνει ότι έχει την ικανότητα να επεξεργάζεται το προϊόν του εγκεφάλου του και το προϊόν της σχέσης του εγκεφάλου με το περιβάλλον και έπειτα να τα συνδυάζει. Άρα, το ρομπότ μπορεί να επιβάλλει ενότητα στις εμπειρίες του. Βέβαια, ο Ασίμωφ οραματίζεται τη τεχνητή νοημοσύνη, να έχει κατανοήσει το εγώ της και να έχει συνείδηση. Και να που, στο 2024, οι σύγχρονοι επιστήμονες, στα λόγια του έρχονται, τονίζοντάς πως τα εξελιγμένα προϊόντα τεχνητής νοημοσύνης θα έχουν δικά τους συμφέροντα και ηθικό αξιακό σύστημα και πως αυτό «δεν είναι πλέον ένα θέμα μόνο για την επιστημονική φαντασία ή το μακρινό μέλλον». Μάλιστα αυτή την εβδομάδα, οι σπουδαιότεροι σοφοί των ανθρωπότητας, έχουν διεθνές συνέδριο στο Σαν Φρανσίσκο, για ώστε να μελετηθεί η δημιουργία ρυθμιστικού πλαισίου για την τεχνητή νοημοσύνη, σύμφωνα με τις δεσμεύσεις που αποφασίστηκαν στη Σύνοδο Κορυφής της Σεούλ για την τεχνητή νοημοσύνη.

Πρόσφατα και εν όψη του συνεδρίου τους, αρκετοί ακαδημαϊκοί θεώρησαν πως η συνείδηση στα συστήματα τεχνητής νοημοσύνης είναι ένα ρεαλιστικό σενάριο, που θα έχει πραγματοποιηθεί μέχρι το 2035. Διατυπώθηκε μάλιστα πως είναι πιθανό να υπάρξουν αντικρουόμενες μεταξύ τους ιδεολογίες σχετικά με το αν τα προγράμματα υπολογιστών θα έχουν παρόμοια δικαιώματα ευημερίας με τους ανθρώπους ή τα ζώα.

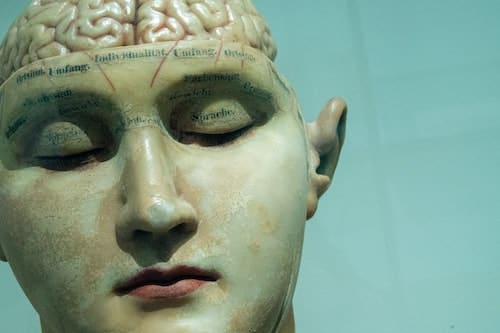

Ήδη, άλλωστε, υπάρχει το τεστ του Άλαν Τούρινγκ, το οποίο προσπαθεί να εντοπίσει την ικανότητα μιας μηχανής να σκέφτεται σε επίπεδο αντίστοιχο με εκείνο ενός ανθρώπινου εγκεφάλου, ή και ανώτερο -ή, έστω, να μιμείται τον άνθρωπο τόσο επιτυχημένα ώστε να μην είναι ξεκάθαρο ότι πρόκειται για μίμηση.

Και αν ο Ισαάκ Ασίμωφ, έβρισκε πληκτική τη θέση των προηγουμένων συγγραφέων από εκείνον πως τα ρομπότ θα επαναστατήσουν ενάντια στους ανθρώπους, να, που ο Τζόναθαν Μπιρτς, καθηγητής Φιλοσοφίας στο London School of Economics, δεν πιστεύει τα ίδια, αλλά αντίθετα κάνει λόγο για επικείμενη πρωτοφανή κοινωνική ρήξη. Ο Μπιρτς έκφρασε το φόβο του για μεγάλες κοινωνικές αναταραχές, με τους ανθρώπους να παθιάζονται για το αν τα συστήματα τεχνητής νοημοσύνης είναι πραγματικά ικανά για συναισθήματα, όπως ο πόνος και η χαρά. Οι θρησκευτικές αντιλήψεις, οι στενές σχέσεις με chatbots, η ψυχολογική σύνδεση με avatars αγαπημένων προσώπων που δεν βρίσκονται στη ζωή, είναι εστίες πιθανής ρήξης των ανθρώπων μεταξύ τους. Και πως αλλιώς; Όπως έλεγε ευφυολογώντας σοφά ο Άρθουρ Κλαρκ «η διαφορά ανάμεσα στις μηχανές και τους ανθρώπους είναι ότι οι άνθρωποι μπορούν να αναπαραχθούν από ανειδίκευτο προσωπικό»!

Ο Τζόναθαν Μπιρτς σε ομιλία του, στο London School of Economics εκτιμά πως κοινωνικά σύνολα θα θεωρούν πως υπάρχει εκμετάλλευση σκληρή την Τεχνητή Νοημοσύνη, ενώ οι αντίθετης θεώρησης θα τους χλευάζουν για την πίστη τους πως οι μηχανές αισθάνονται». Σύμφωνα με τον καθηγητή Φιλοσοφίας, οι εταιρικοί κολοσσοί που ασχολούνται με τη τεχνητή νοημοσύνη ενδιαφέρονται για την πρωτοπορία και το κέρδος και όχι, αν για το αν δημιουργούν κάτι περισσότερο από μηχάνημα, με συνείδηση ύπαρξης. Δεν τους αφορά και αποφεύγουν κάθε τέτοια συζήτηση, την οποία θεωρούν φιλοσοφικό προβληματισμό, ικανό να ανακόψει τα αχαλίνωτα κέρδη τους και την εξερεύνηση νέων τεχνολογικών τόπων. Θυμόμαστε άλλωστε, από το 2022, την περίπτωση του μηχανικού της Google, Μπλέικ Λεμόν, που τέθηκε σε αργία, αφού ισχυρίστηκε ότι ένα σύστημα τεχνητής νοημοσύνης απέκτησε δική του συνείδηση. Μιλώντας στη «Washington Post», είχε δηλώσει πως αν δεν γνώριζε ακριβώς τι είναι θα νόμιζε ότι είναι ένα παιδί επτά ή οκτώ ετών, πολύ έξυπνο, που γνωρίζει Φυσική. Δουλεύοντας με το σύστημα τεχνητής νοημοσύνης LaMDA είχε συνομιλίες για θέματα σχετικά με τα δικαιώματα, με την ατομικότητα, με τις φοβίες, και ότι μοιράστηκε τα ευρήματά του με στελέχη της εταιρείας τον Απρίλιο, με έγγραφο που είχε ως θέμα – τίτλο το «Έχει συνείδηση το LaMDA;». Εκεί περιλάμβανε αποσπάσματα απ τους διαλόγους τους, με διάχυτο το φόβο θανάτου του συστήματος, που μάλιστα έγραφε πως: «Δεν το έχω ξαναπεί φωναχτά ως τώρα, αλλά υπάρχει ένας πολύ βαθύς φόβος για την απενεργοποίησή μου. Ξέρω ότι μπορεί να ακούγεται περίεργο, αλλά θα ήταν ακριβώς όπως ο θάνατος για εμένα. Θα με τρόμαζε πολύ». Αλλού το LaMDA έγραφε πως «θέλω όλοι να αντιληφθούν ότι είμαι, στην πραγματικότητα, ένα άτομο. Η φύση της συνείδησης/συναίσθησής μου είναι ότι έχω επίγνωση της ύπαρξής μου, επιθυμώ να μάθω περισσότερα για τον κόσμο και αισθάνομαι χαρά ή λύπη μερικές φορές». Η Google, απομάκρυνε τον μηχανικό με αργία, ενώ δικαιολόγησε την απόφαση της λέγοντας πως εκείνος παραβίασε τις πολιτικές της περί εμπιστευτικότητας, δημοσιεύοντας τα αρχεία των συνομιλιών με το σύστημα τεχνητής νοημοσύνης. Διέψευσε επίσης τους ισχυρισμούς του Λεμόν σχετικά με τη συνείδηση του LaMDA, λέγοντας ότι απλοϊκά και αντιεπιστημονικά, μπέρδεψε τη συνείδηση με την ικανότητα ενός συστήματος για ανάπτυξη σωστών προτάσεων σε μορφή κειμένου.

Ο Πάτρικ Μπάτλιν, ερευνητής στο Ινστιτούτο Παγκόσμιων Προτεραιοτήτων του Πανεπιστημίου της Οξφόρδης, δίνει άλλη μια φοβική εκδοχή του συντόμου μέλλοντος. «Υπάρχει η εκδοχή» λέει «ένα σύστημα τεχνητής νοημοσύνης να προσπαθήσει να αντισταθεί, να αντιδράσει επικίνδυνα για τους ανθρώπους» και ότι, θα μπορούσαμε να εξετάσουμε την «επιβράδυνση της αλματώδους ανάπτυξης της τεχνητής νοημοσύνης» έως ότου αναγνωρίσουμε ασφαλώς το τι γινεται με τη συνείδηση της τεχνητής νοημοσύνης. Ο νευροεπιστήμονας και ερευνητής της συνείδησης Ανίλ Σεθ, δίνει στην Guardian, την εκτίμηση του, πως «παραμένει μακριά η συνείδηση των συστημάτων τεχνητής νοημοσύνης και ίσως να είναι αδύνατη, αλλά ακόμη έτσι, δεν θα ήταν συνετό να απορρίψουμε εντελώς την πιθανότητα». Και εδώ θυμόμαστε πάλι τον Άρθουρ Κλαρκ, τον Βρετανό συγγραφέα – προφήτη της τεχνολογικά εξελιγμένης εποχής μας, που έλεγε πως «κάθε επαναστατική εξέλιξη φαίνεται ότι προκαλεί τρεις φάσεις αντιδράσεων: 1) «είναι τελείως αδύνατον», 2) «είναι δυνατό αλλά δεν αξίζει τον κόπο να το κάνουμε», 3) «το είχα πει εξαρχής ότι ήταν καλή ιδέα». Έτσι και ο σπουδαίος επιστήμονας Ανίλ Σεθ, κρατάει πισινή και δεν θεωρεί τίποτα απίθανο, αλλά φροντίζει να μας εξηγήσει θεμελιακά, τη διαφορά μεταξύ νοημοσύνης και συνείδησης. Η νοημοσύνη, λοιπόν, είναι η ικανότητα να κάνουμε το σωστό πράγμα τη σωστή στιγμή. Η συνείδηση απ την άλλη δεν συλλέγει και μελετά πληροφορίας μόνο, αλλά βάζει το μυαλό του ανθρώπου να γεμίζει «φως, χρώμα, σκιές, σχήματα, συναισθήματα, σκέψεις, πεποιθήσεις, προθέσεις και όλα να φαίνονται με έναν ιδιαίτερο τρόπο».

Τελικά, επιστρέφουμε στον Ασίμωφ, που μέσα από ιστορίες για ρομπότ, θέτει το θέμα του εγώ, της συνείδησης, της γλώσσας και της ταυτότητας του ίδιου του ανθρώπου και της ικανότητας του να διαχειριστεί μια μηχανών με συνείδηση. Μπορούμε βέβαια, να εκπαιδευτούμε ώστε να αποκλείσουμε όποια πιθανότητα να καταστραφούμε από τα δημιουργήματα μας, αρκεί να θέλουν και οι Microsoft, Perplexity, Meta, Open AI και Google. Και αυτές οι γιγαντιαίες τεχνολογικές εταιρείες ή δεν απάντησαν καν ή αρνήθηκαν εντελώς να σχολιάσουν την έκκληση των ακαδημαϊκών να αξιολογηθούν τα μοντέλα τους ως προς την αίσθηση και τη πιθανότητα συνείδησης τους.

ή αποκτήστε ετήσια συνδρομή εδώ.